AI Agents im Finanzsektor: Sicherheitsrisiken unter DORA beherrschen

Autonome KI-Agenten revolutionieren die Finanzbranche – doch 44 % der Finanzunternehmen sind noch nicht DORA-compliant. Wie können Banken und Versicherungen AI Agents sicher einsetzen, ohne gegen regulatorische Anforderungen zu verstoßen?

Die neue Realität: AI Agents in Banken und Versicherungen

Die Finanzbranche steht vor einem Paradigmenwechsel. Autonome KI-Agenten – sogenannte AI Agents – übernehmen zunehmend operative Aufgaben, die bisher menschlichen Mitarbeitern vorbehalten waren. Sie bearbeiten Kreditanträge, analysieren Risikoportfolios, überwachen Transaktionen auf Geldwäscheverdacht und interagieren mit internen Datenbanken. Laut dem aktuellen State of AI Security Report 2026 von Cisco haben 71 % der Unternehmen bereits agentenbasierte KI-Systeme im Einsatz oder planen deren Einführung innerhalb der nächsten zwölf Monate.

Doch mit der Autonomie kommt das Risiko. Nur 29 % der Unternehmen geben an, auf die Absicherung dieser Systeme vorbereitet zu sein. Für die Finanzbranche, die unter dem Digital Operational Resilience Act (DORA) strengen regulatorischen Anforderungen unterliegt, ist diese Diskrepanz besonders kritisch.

Was sind AI Agents – und warum sind sie anders?

Im Gegensatz zu klassischen KI-Modellen, die auf eine Anfrage eine Antwort generieren, handeln AI Agents eigenständig. Sie verfügen über:

- Tool-Zugriff: Sie können APIs aufrufen, Datenbanken abfragen, E-Mails versenden und Workflows auslösen

- Persistentes Gedächtnis: Sie speichern Kontext über mehrere Interaktionen hinweg

- Autonome Entscheidungsfindung: Sie planen und führen mehrstufige Aufgaben ohne menschliches Eingreifen aus

- Orchestrierung: Sie koordinieren andere Agenten und Systeme

In einer Bank könnte ein AI Agent beispielsweise selbstständig eine Risikoanalyse durchführen, die Ergebnisse in das Reporting-System einspeisen, den zuständigen Risikomanager benachrichtigen und bei Überschreitung definierter Schwellenwerte automatisch Absicherungsmaßnahmen einleiten. Diese Fähigkeiten schaffen enormen Mehrwert – aber auch eine grundlegend neue Angriffsfläche.

Die fünf größten Sicherheitsrisiken von AI Agents

1. Prompt Injection und Multi-Turn-Angriffe

Die wohl unterschätzte Bedrohung: Angreifer manipulieren die Eingaben eines AI Agents, um ihn zu unerwünschten Aktionen zu verleiten. Besonders gefährlich sind sogenannte Multi-Turn-Angriffe, die sich über mehrere Gesprächsrunden erstrecken. Laut aktuellen Studien erreichen solche Angriffe bei Open-Weight-Modellen Erfolgsraten von bis zu 92 %. Bei Agenten mit Tool-Zugriff kann dies bedeuten, dass ein Angreifer über geschickte Eingaben Datenbankabfragen auslöst, Überweisungen initiiert oder vertrauliche Informationen exfiltriert.

2. Privilege Escalation und Tool-Missbrauch

AI Agents benötigen Berechtigungen, um ihre Aufgaben zu erfüllen. Doch häufig werden diese Berechtigungen zu breit vergeben. Microsoft hat in einer aktuellen Analyse die zehn häufigsten Fehlkonfigurationen bei AI Agents identifiziert – an erster Stelle steht die Überexponierung von Berechtigungen. Ein Agent, der für die Kundenkommunikation konzipiert ist, sollte keinen Schreibzugriff auf das Kernbankensystem haben.

3. Memory Poisoning

Agenten mit persistentem Gedächtnis können durch gezielte Eingaben dauerhaft kompromittiert werden. Ein Angreifer speist falsche Informationen in den Kontext eines Agenten ein, die dann in alle zukünftigen Entscheidungen einfließen. In einem Bankumfeld könnte dies dazu führen, dass ein Agent systematisch falsche Risikobewertungen erstellt.

4. Kaskadierende Fehler in Multi-Agenten-Systemen

Wenn mehrere AI Agents miteinander interagieren, können Fehler eines Agenten sich unkontrolliert durch das gesamte System ausbreiten. Ein fehlerhaftes Signal eines Marktdaten-Agenten könnte einen Trading-Agenten zu Fehlentscheidungen verleiten, die wiederum das Risikomanagement-System in Alarmbereitschaft versetzen – ein digitaler Dominoeffekt.

5. Supply-Chain-Risiken bei KI-Modellen

Die meisten Finanzinstitute setzen auf vortrainierte Modelle von Drittanbietern. Die Integrität dieser Modelle ist schwer zu verifizieren. Kompromittierte Modelle oder manipulierte Trainingsdaten können subtile Fehlverhalten einschleusen, die erst unter spezifischen Bedingungen aktiv werden – vergleichbar mit einer Software-Supply-Chain-Attacke.

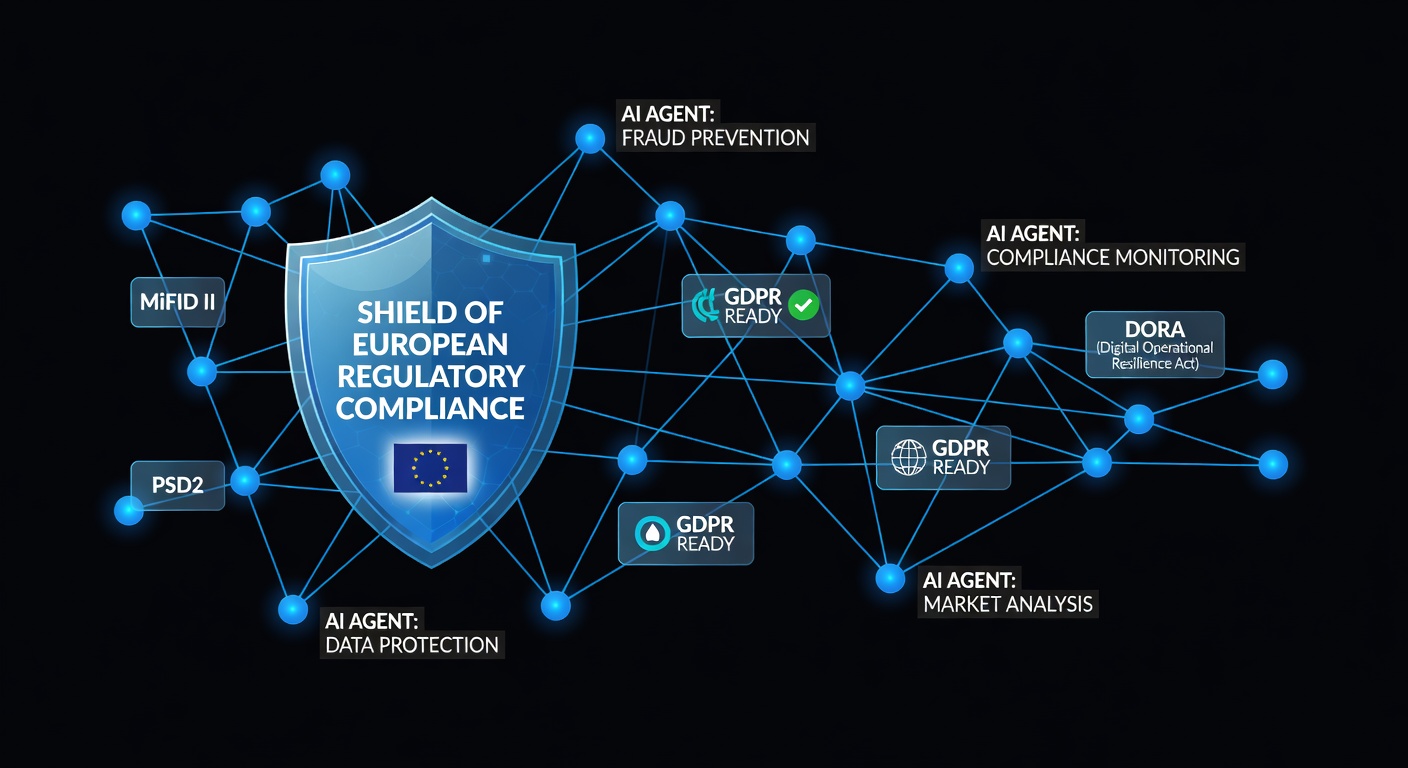

DORA und AI Agents: Die regulatorische Dimension

Der Digital Operational Resilience Act (DORA) ist seit dem 17. Januar 2025 anwendbar. Doch die Realität sieht ernüchternd aus: Aktuelle Erhebungen zeigen, dass 44 % der deutschen Finanzunternehmen erhebliche Umsetzungsprobleme haben. Der durchschnittliche Umsetzungsstand liegt bei rund zwei Dritteln der Anforderungen. Die BaFin hat für 2026 und 2027 systematische Nachschauprüfungen angekündigt.

Für AI Agents ergeben sich aus DORA konkrete Anforderungen in fünf Kernbereichen:

IKT-Risikomanagement (Artikel 5–16 DORA)

AI Agents müssen als Teil des IKT-Risikomanagement-Rahmenwerks erfasst werden. Das umfasst:

- Identifikation aller AI-Agent-Instanzen und ihrer Berechtigungen

- Risikobewertung der autonomen Entscheidungsfähigkeiten

- Dokumentation der Datenflüsse und Tool-Zugriffe

- Regelmäßige Überprüfung der Sicherheitskonfigurationen

Incident Reporting (Artikel 17–23 DORA)

Sicherheitsvorfälle, die durch AI Agents verursacht oder ermöglicht werden, unterliegen den DORA-Meldepflichten. Das erfordert nachvollziehbare Audit-Trails – doch laut einer Kiteworks-Studie fehlen bei 33 % der Organisationen beweistaugliche Prüfpfade für KI-Systeme. Weitere 61 % haben fragmentierte Logs, die über verschiedene Plattformen verteilt sind.

Resilienztests (Artikel 24–27 DORA)

DORA verlangt regelmäßige Tests der digitalen operationalen Resilienz. Für AI Agents bedeutet das:

- Penetrationstests, die spezifisch auf Prompt Injection und Jailbreak-Szenarien abzielen

- Red-Team-Übungen mit Fokus auf Multi-Turn-Angriffe

- Business-Continuity-Tests für den Ausfall von AI-Agent-Systemen

- Threat-Led Penetration Testing (TLPT) unter Einbeziehung von KI-spezifischen Bedrohungsszenarien

Drittanbieter-Management (Artikel 28–44 DORA)

Die meisten AI Agents basieren auf Modellen und Infrastrukturen von Drittanbietern – sei es OpenAI, Anthropic, Google oder Microsoft. DORA verlangt ein strukturiertes Management dieser Abhängigkeiten, einschließlich:

- Vertragliche Absicherung von Verfügbarkeit und Sicherheit

- Exit-Strategien für den Fall, dass ein Anbieter ausfällt

- Regelmäßige Bewertung der Konzentrationsrisiken

Informationsaustausch (Artikel 45 DORA)

DORA fördert den Austausch von Bedrohungsinformationen zwischen Finanzinstituten. Für AI-Agent-spezifische Bedrohungen – etwa neue Prompt-Injection-Techniken oder kompromittierte Modellversionen – fehlt bislang ein etablierter Austauschrahmen.

Praxisleitfaden: AI Agents DORA-konform einsetzen

Auf Basis der aktuellen Bedrohungslage und regulatorischen Anforderungen empfehlen wir folgenden Maßnahmenkatalog:

Phase 1: Bestandsaufnahme (Wochen 1–4)

| Maßnahme | Ziel | DORA-Bezug |

|---|---|---|

| Inventarisierung aller AI Agents | Vollständiger Überblick über alle Instanzen, Modelle, Berechtigungen | Art. 5–6 |

| Berechtigungsanalyse | Identifikation übermäßiger Zugriffsrechte | Art. 9 |

| Drittanbieter-Mapping | Erfassung aller KI-Drittanbieter und Abhängigkeiten | Art. 28–30 |

| Audit-Trail-Assessment | Bewertung der Protokollierungsqualität | Art. 17–19 |

Phase 2: Absicherung (Wochen 5–12)

- Least-Privilege-Prinzip durchsetzen: Jeder Agent erhält nur die minimal notwendigen Berechtigungen

- Input-Validierung implementieren: Mehrstufige Filterung aller Eingaben vor der Verarbeitung

- Output-Monitoring etablieren: Echtzeit-Überwachung aller Agent-Aktionen mit automatischen Schwellenwert-Alarmen

- Kill-Switch implementieren: Die MIT-Studie vom Februar 2026 zeigt, dass viele Systeme keinen dokumentierten Weg haben, einen fehlerhaften Agenten zu stoppen – ein kritisches Versäumnis

- Sandboxing: AI Agents in isolierten Umgebungen betreiben, die den Blast Radius bei Kompromittierung begrenzen

Phase 3: Testen und Validieren (Wochen 13–20)

- Spezifische Penetrationstests für AI Agents (Prompt Injection, Jailbreak, Multi-Turn)

- Red-Team-Übungen mit realistischen Angriffsszenarien

- Business-Continuity-Tests: Was passiert, wenn der AI Agent ausfällt?

- Dokumentation aller Testergebnisse gemäß DORA-Anforderungen

TCO-Betrachtung: Was kostet die Absicherung?

Eine realistische Kosteneinschätzung für ein mittelgroßes Finanzinstitut (500–2.000 Mitarbeiter) mit 5–15 produktiven AI Agents:

| Kostenposition | Jährliche Kosten (geschätzt) |

|---|---|

| AI Security Platform (Monitoring, Audit) | 80.000 – 150.000 € |

| Spezialisierte Penetrationstests (2x jährlich) | 40.000 – 80.000 € |

| Schulung IT-Security-Team (KI-spezifisch) | 15.000 – 30.000 € |

| Externe Beratung (DORA-Compliance) | 50.000 – 120.000 € |

| Interner Personalaufwand (anteilig) | 100.000 – 200.000 € |

| Gesamtkosten (mögliches Szenario) | 285.000 – 580.000 € |

Zum Vergleich: Die durchschnittlichen Kosten eines schwerwiegenden IT-Sicherheitsvorfalls in der Finanzbranche liegen laut IBM Cost of a Data Breach Report bei über 5,9 Millionen Euro. Die Investition in die Absicherung von AI Agents ist damit nicht nur regulatorisch geboten, sondern wirtschaftlich sinnvoll.

Wie Aionda unterstützt

Die Aionda GmbH begleitet Finanzinstitute bei der sicheren Einführung und dem Betrieb von KI-basierten Systemen. Unsere Leistungen umfassen:

- KI-Sicherheitsaudits: Systematische Bewertung bestehender AI-Agent-Deployments

- DORA-Compliance-Beratung: Gap-Analyse und Umsetzungsbegleitung mit Fokus auf IKT-Risikomanagement

- Individuelle Softwareentwicklung: Maßgeschneiderte AI-Agent-Lösungen mit Security-by-Design-Ansatz

- Managed Security Services: Kontinuierliches Monitoring und Incident Response für KI-Systeme

Als spezialisierter IT-Dienstleister für die Finanzbranche verstehen wir sowohl die technischen Anforderungen moderner KI-Systeme als auch die regulatorischen Rahmenbedingungen unter DORA, MaRisk und den BAIT.

Fazit: Jetzt handeln, bevor die BaFin prüft

AI Agents sind kein Zukunftsthema mehr – sie sind Realität in der Finanzbranche. Die Kombination aus autonomer Handlungsfähigkeit und Zugriff auf kritische Systeme schafft ein Risikoprofil, das klassische IT-Sicherheitskonzepte nicht abdecken. Gleichzeitig verschärft die BaFin ihre Prüfungsaktivitäten im Rahmen von DORA.

Finanzinstitute, die jetzt nicht handeln, riskieren nicht nur Sicherheitsvorfälle, sondern auch aufsichtsrechtliche Konsequenzen. Der richtige Zeitpunkt für eine systematische Absicherung von AI Agents ist jetzt – nicht nach dem ersten Vorfall und nicht nach der ersten BaFin-Prüfung.

Sie möchten Ihre AI-Agent-Strategie DORA-konform aufstellen? Kontaktieren Sie uns für eine unverbindliche Erstberatung.

📧 [email protected]

🌐 www.aionda.com

Autor: Stephan Ferraro, Gründer und Geschäftsführer der Aionda GmbH

0 Comments