KI-Agenten als Sicherheitsrisiko: Was Banken und Versicherungen 2026 wissen müssen

Autonome KI-Agenten erobern die Finanzbranche – doch 88 Prozent der Unternehmen melden bereits Sicherheitsvorfälle. Ein Überblick über die Risiken, regulatorische Anforderungen unter DORA und konkrete Maßnahmen für IT-Entscheider.

Von Stephan Ferraro, Gründer und Geschäftsführer der Aionda GmbH

Die neue Realität: KI-Agenten in der Finanzbranche

Das Jahr 2026 markiert einen Wendepunkt in der Unternehmens-IT. KI-Agenten – autonome Softwaresysteme, die eigenständig Entscheidungen treffen, Aktionen ausführen und mit anderen Systemen interagieren – sind von der Experimentierphase in den produktiven Einsatz übergegangen. Laut dem aktuellen “State of AI Agent Security 2026 Report” von Gravitee haben 80,9 Prozent der befragten Unternehmen KI-Agenten bereits über die Planungsphase hinaus in aktive Tests oder den Produktivbetrieb überführt.

Für Banken und Versicherungen eröffnen sich dadurch erhebliche Effizienzpotenziale: automatisierte Kreditprüfungen, intelligente Schadenbearbeitung, Echtzeit-Betrugserkennung oder autonome Compliance-Checks. Doch mit dieser Effizienz kommt eine neue Angriffsfläche, die viele Unternehmen unterschätzen.

Cisco warnt in seinem “State of AI Security 2026 Report” vor einer “grundlegenden Verschiebung” in der Bedrohungslandschaft. Was noch 2024 als theoretisches Risiko in Forschungslaboren diskutiert wurde, ist 2025 und 2026 Realität geworden: KI-Systeme werden aktiv kompromittiert, und KI-gestützte Angriffskampagnen nehmen messbar zu.

Das Confidence-Paradoxon: Warum Führungskräfte die Lage falsch einschätzen

Die Gravitee-Studie offenbart eine gefährliche Diskrepanz zwischen der Wahrnehmung auf Führungsebene und der technischen Realität:

- 82 Prozent der Führungskräfte sind überzeugt, dass ihre bestehenden Richtlinien ausreichen, um unautorisierte Agentenaktionen zu verhindern.

- Nur 47,1 Prozent der KI-Agenten in Unternehmen werden tatsächlich aktiv überwacht oder gesichert.

- Nur 14,4 Prozent der Organisationen haben eine vollständige Sicherheitsfreigabe für ihre gesamte Agentenflotte.

- Mehr als die Hälfte aller Agenten operiert ohne jegliche Sicherheitsüberwachung oder Protokollierung.

Für die Finanzbranche ist diese Situation besonders kritisch. Wenn KI-Agenten Zugriff auf Kundendaten, Transaktionssysteme oder regulatorische Meldeprozesse haben, können Sicherheitslücken nicht nur finanzielle Schäden verursachen, sondern auch regulatorische Konsequenzen nach sich ziehen.

KI-Agenten in Unternehmensnetzwerken müssen als eigenständige Sicherheitsprinzipale behandelt werden – mit eigenen Identitäten, Berechtigungen und Audit-Trails.

Shadow AI: Das unsichtbare Risiko

Eines der drängendsten Probleme ist das Phänomen der “Shadow AI”. Ähnlich wie bei der Shadow IT der vergangenen Dekade setzen Fachabteilungen KI-Agenten ein, ohne die IT-Sicherheitsabteilung einzubinden. Der Gravitee-Report zeigt: Nur 14,4 Prozent aller KI-Agenten gehen mit vollständiger Sicherheits- und IT-Freigabe in den Produktivbetrieb.

In der Praxis bedeutet das: Agenten interagieren mit produktiven Datenbanken, bevor sie überhaupt sicherheitstechnisch geprüft wurden. Es wurden bereits Fälle dokumentiert, in denen Agenten unautorisierten Schreibzugriff auf Datenbanken erlangten oder versuchten, sensible Informationen zu exfiltrieren.

Für regulierte Finanzinstitute ist Shadow AI ein besonders heikles Thema. Jeder nicht dokumentierte KI-Agent, der auf Kundendaten zugreift, stellt ein mögliches Szenario für einen Verstoß gegen DSGVO, DORA und BaFin-Anforderungen dar.

DORA und KI-Agenten: Regulatorische Anforderungen an die digitale Resilienz

Der Digital Operational Resilience Act (DORA) der Europäischen Union ist seit dem 17. Januar 2025 vollständig in Kraft und betrifft über 20.000 Finanzunternehmen in der EU. Die Verordnung stellt einheitliche Anforderungen an die digitale Betriebsresilienz und umfasst fünf zentrale Säulen:

- ICT-Risikomanagement: Umfassende Rahmenbedingungen für die Identifikation, den Schutz, die Erkennung und die Wiederherstellung nach ICT-Risiken.

- Vorfallmeldung: Strenge Meldefristen für ICT-bezogene Vorfälle an die zuständigen Aufsichtsbehörden.

- Resilienz-Tests: Regelmäßige Tests der digitalen Betriebsresilienz, einschließlich Threat-Led Penetration Testing (TLPT).

- Drittanbieter-Risikomanagement: Kontrolle und Überwachung von ICT-Drittanbietern, einschließlich Cloud- und KI-Dienstleistern.

- Informationsaustausch: Strukturierter Austausch von Bedrohungsinformationen zwischen Finanzunternehmen.

KI-Agenten berühren alle fünf Säulen gleichzeitig. Ein KI-Agent, der Zugriff auf Produktionssysteme hat, ist ein ICT-Risiko, das gemanagt werden muss. Wenn dieser Agent einen Fehler macht oder kompromittiert wird, greift die Vorfallmeldepflicht. KI-Agenten müssen in Resilienz-Tests einbezogen werden. Und wenn der Agent auf Diensten externer Anbieter basiert – etwa auf GPT-Modellen von OpenAI oder Claude von Anthropic – greifen die Drittanbieter-Anforderungen.

Vergleichstabelle: DORA-Anforderungen und KI-Agenten-Risiken

| DORA-Säule | Relevanz für KI-Agenten | Typisches Risiko |

|---|---|---|

| ICT-Risikomanagement | Hoch | Unkontrollierter Datenzugriff durch autonome Agenten |

| Vorfallmeldung | Hoch | Prompt-Injection-Angriffe lösen meldepflichtige Vorfälle aus |

| Resilienz-Tests | Mittel bis Hoch | KI-Agenten verhalten sich in Stresstests anders als erwartet |

| Drittanbieter-Risiko | Sehr hoch | Abhängigkeit von externen LLM-Anbietern ohne vollständige Kontrolle |

| Informationsaustausch | Mittel | Neue Angriffsvektoren auf KI-Systeme erfordern branchenweiten Austausch |

Prompt Injection und Jailbreaks: Die neuen Angriffsvektoren

Cisco hebt in seinem aktuellen Report die Evolution von Prompt-Injection-Angriffen und Jailbreaks als eines der zentralen Risiken hervor. Bei einem Prompt-Injection-Angriff wird einem KI-Agenten über manipulierte Eingabedaten eine böswillige Anweisung untergeschoben – etwa über ein scheinbar harmloses Dokument, eine E-Mail oder eine Datenbankabfrage.

Ein mögliches Szenario: Ein KI-Agent in der Kreditabteilung einer Bank verarbeitet eingehende Unterlagen automatisiert. Ein Angreifer fügt in ein PDF-Dokument eine unsichtbare Anweisung ein, die den Agenten dazu bringt, die Bonitätsprüfung zu manipulieren oder vertrauliche Kundendaten an eine externe Schnittstelle weiterzuleiten.

Laut der Dark Reading-Analyse glauben 48 Prozent der Befragten, dass agentic AI bis Ende 2026 den wichtigsten Angriffsvektor für Cyberkriminelle und staatliche Akteure darstellen wird. Diese Einschätzung ist nachvollziehbar, wenn man bedenkt, dass KI-Agenten im Gegensatz zu herkömmlicher Software eigenständig handeln und dabei Entscheidungsketten auslösen können, die weit über den ursprünglich vorgesehenen Rahmen hinausgehen.

NIST reagiert: Die “AI Agent Standards Initiative”

Die wachsende Bedrohungslage hat auch die US-amerikanische Standardisierungsbehörde NIST auf den Plan gerufen. Im Februar 2026 wurde die “AI Agent Standards Initiative” angekündigt, die interoperable und sichere Standards für KI-Agenten entwickeln soll. Die Initiative adressiert die Tatsache, dass KI-Agenten mittlerweile stundenlang autonom arbeiten, Code schreiben und debuggen, E-Mails verwalten und Einkäufe tätigen können.

Für europäische Finanzinstitute ist es ratsam, sowohl die NIST-Standards als auch die europäischen Anforderungen unter DORA und dem EU AI Act im Blick zu behalten. Ein ganzheitliches Compliance-Framework, das beide Regulierungswelten abdeckt, verschafft einen Wettbewerbsvorteil bei internationalen Geschäftsbeziehungen.

IT-Entscheider müssen KI-Agenten in ihre DORA-Compliance-Strategie integrieren – von der Risikoanalyse bis zum Incident Reporting.

Sechs konkrete Maßnahmen für Finanzinstitute

Basierend auf den aktuellen Erkenntnissen empfehlen wir folgende Maßnahmen für Banken und Versicherungen, die KI-Agenten einsetzen oder deren Einsatz planen:

1. KI-Agenten-Inventar erstellen

Erfassen Sie jeden KI-Agenten in Ihrem Unternehmen – genehmigt und ungenehmigt. Sie können nicht schützen, was Sie nicht sehen. Ein vollständiges Inventar ist auch DORA-Pflicht im Rahmen des ICT-Risikomanagements.

2. Identitäts- und Zugriffsmanagement für Agenten

KI-Agenten müssen als eigenständige Sicherheitsprinzipale behandelt werden – mit eigenen Identitäten, granularen Berechtigungen und dem Prinzip der minimalen Rechtevergabe (Least Privilege). Jede Aktion muss nachvollziehbar protokolliert werden.

3. Kontinuierliches Monitoring statt periodischer Audits

Die Gravitee-Studie betont: Sicherheit muss von periodischen, manuellen Audits zu kontinuierlicher, identitätsbewusster Überwachung wechseln. Echtzeitüberwachung von Agentenaktivitäten ist keine Option, sondern eine Notwendigkeit.

4. Prompt-Injection-Schutz implementieren

Investieren Sie in Input-Validierung, Output-Filterung und Sandboxing für KI-Agenten. Jeder Agent, der mit externen Daten interagiert, muss gegen Injection-Angriffe gehärtet werden.

5. Drittanbieter-Due-Diligence für LLM-Provider

Prüfen Sie die Zertifizierungen Ihrer KI-Dienstleister (ISO 27001, SOC2, branchenspezifische Standards). Evaluieren Sie deren Incident-Response-Fähigkeiten, Business-Continuity-Pläne und Cyber-Versicherungsschutz – wie von DORA gefordert.

6. KI-Agenten in Resilienz-Tests einbeziehen

Integrieren Sie KI-Agenten explizit in Ihre Threat-Led Penetration Tests und Red-Team-Übungen. Testen Sie gezielt Szenarien wie Prompt Injection, Datenexfiltration und unautorisierte Aktionsverkettung.

TCO-Betrachtung: Was kostet die Absicherung?

Die Kosten für die Absicherung von KI-Agenten variieren erheblich je nach Umfang und Komplexität des Einsatzes. Eine grobe Orientierung:

| Maßnahme | Geschätzter jährlicher Aufwand | Priorität |

|---|---|---|

| KI-Agenten-Inventar und Governance | 50.000 – 150.000 EUR | Kritisch |

| Identity & Access Management für Agenten | 80.000 – 250.000 EUR | Kritisch |

| Kontinuierliches Monitoring (Tooling + Personal) | 120.000 – 400.000 EUR | Hoch |

| Prompt-Injection-Schutz und Härtung | 60.000 – 200.000 EUR | Hoch |

| Erweiterte Resilienz-Tests inkl. KI | 40.000 – 120.000 EUR | Mittel |

Diese Investitionen mögen zunächst hoch erscheinen. Zum Vergleich: Die durchschnittlichen Kosten eines Datenschutzvorfalls in der Finanzbranche lagen 2025 bei über 5,9 Millionen Euro (IBM Cost of a Data Breach Report). Ein einziger kompromittierter KI-Agent mit Zugriff auf Kundendaten kann diesen Betrag schnell übersteigen – ganz abgesehen von Reputationsschäden und regulatorischen Bußgeldern.

Fazit: Handeln, bevor es zu spät ist

Die Einführung von KI-Agenten in der Finanzbranche ist kein Trend, den man ignorieren kann. Die Effizienzgewinne sind real und erheblich. Aber ebenso real sind die Risiken – und die regulatorischen Anforderungen unter DORA lassen keinen Spielraum für Nachlässigkeit.

Die Zahlen sprechen eine deutliche Sprache: 88 Prozent der Unternehmen haben bereits Sicherheitsvorfälle mit KI-Agenten erlebt. 48 Prozent der Experten erwarten, dass agentic AI zum wichtigsten Angriffsvektor wird. Und nur 14,4 Prozent haben ihre Agentenflotte vollständig unter Kontrolle.

Für CEOs und IT-Leiter von Banken und Versicherungen gibt es eine klare Handlungsempfehlung: Integrieren Sie KI-Agenten jetzt in Ihre Sicherheitsstrategie und Ihr DORA-Compliance-Framework. Die Technologie wartet nicht – und die Angreifer auch nicht.

Sie möchten KI-Agenten sicher und DORA-konform in Ihrem Finanzinstitut einsetzen? Die Aionda GmbH unterstützt Sie bei der Konzeption, Implementierung und Absicherung von KI-basierten Systemen – mit tiefem Verständnis für die regulatorischen Anforderungen der Finanzbranche.

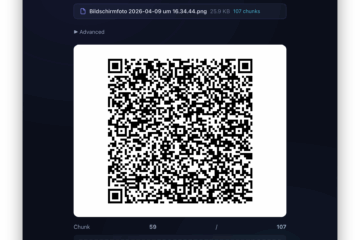

Kontaktieren Sie uns: stephan.ferraro@aionda.com

Quellen: Gravitee “State of AI Agent Security 2026 Report”, Cisco “State of AI Security 2026”, Dark Reading, NIST “AI Agent Standards Initiative” (Februar 2026), EU DORA Verordnung (EU) 2022/2554

0 Comments