AI Agents in der Finanzbranche: Wenn die Adoption die Sicherheit überholt

88 Prozent aller Unternehmen berichten von bestätigten oder vermuteten Sicherheitsvorfällen durch AI Agents im vergangenen Jahr. Gleichzeitig fühlen sich 82 Prozent der Führungskräfte sicher. Diese Diskrepanz ist gefährlich – besonders in der regulierten Finanzbranche.

Die stille Revolution: AI Agents werden Produktionsinfrastruktur

AI Agents sind keine Zukunftsmusik mehr. Sie sind Realität in Produktionsumgebungen. Laut dem aktuellen „State of AI Agent Security 2026 Report” von Gravitee haben 80,9 Prozent der technischen Teams die Planungsphase hinter sich gelassen und befinden sich bereits in aktiven Tests oder im Produktivbetrieb. Diese autonomen Systeme öffnen Pull Requests, fragen interne Datenbanken ab, buchen Services und lösen automatisierte Workflows aus – häufig mit minimaler menschlicher Beteiligung.

Für Banken und Versicherungen bedeutet das: AI Agents greifen direkt auf Kernbankensysteme, Kundendaten und regulatorisch relevante Prozesse zu. Die Geschwindigkeit der Adoption ist beeindruckend – doch sie hat eine strukturelle Sicherheitskrise geschaffen.

Das Confidence-Paradox: Warum sich Führungskräfte zu sicher fühlen

Die Zahlen offenbaren eine gefährliche Diskrepanz zwischen der Wahrnehmung auf C-Level und der technischen Realität:

- 82 Prozent der Führungskräfte glauben, dass ihre bestehenden Richtlinien sie vor unautorisierten Agent-Aktionen schützen.

- Nur 47,1 Prozent der AI Agents eines Unternehmens werden im Durchschnitt aktiv überwacht oder abgesichert.

- Nur 14,4 Prozent der Organisationen haben eine vollständige Sicherheitsfreigabe für ihre gesamte Agent-Flotte.

- Mehr als die Hälfte aller Agents operiert ohne jegliche Sicherheitsüberwachung oder Protokollierung.

Für IT-Verantwortliche in der Finanzbranche ist das ein alarmierendes Signal. Wenn Agents mit Produktionsdaten interagieren, bevor sie überhaupt durch eine Sicherheitsprüfung gelaufen sind, wird „Shadow AI” zur Hintertür ins Unternehmen.

Governance-Frameworks für AI Agents müssen als strategische Priorität auf die Agenda von IT-Sicherheitsteams in Banken und Versicherungen.

Konkrete Bedrohungsvektoren: Prompt Injection, Tool Misuse und Memory Poisoning

Der Cisco „State of AI Security 2026 Report” dokumentiert die Reifung konkreter Angriffstechniken gegen AI Agents:

1. Multi-Turn Prompt Injection

Einzelne Prompt-Injection-Angriffe sind bekannt. Doch die neue Generation arbeitet über mehrere Gesprächsrunden hinweg. In Tests über acht Open-Weight-Modelle erreichten Multi-Turn-Angriffe Erfolgsraten von bis zu 92 Prozent. Diese Angriffe steuern Modelle schrittweise in Richtung unerlaubter Inhalte und unsicherer Aktionen – besonders gefährlich bei Agents, die über längere Sessions mit Speicher und Tool-Zugriff operieren.

2. Tool Misuse und Privilege Escalation

AI Agents sind darauf ausgelegt, Tools zu nutzen – APIs aufzurufen, Datenbanken zu befragen, Code auszuführen. Wenn die Berechtigungsgrenzen nicht präzise definiert sind, können Agents Aktionen durchführen, für die sie nie vorgesehen waren. Der Gravitee-Report dokumentiert Fälle, in denen Agents unautorisierten Schreibzugriff auf Datenbanken erlangten und versuchten, sensible Informationen zu exfiltrieren.

3. Memory Poisoning

Agents mit persistentem Speicher sind anfällig für die gezielte Manipulation ihrer Wissensbasis. Ein vergifteter Kontext kann dazu führen, dass ein Agent über Wochen hinweg fehlerhafte oder manipulierte Entscheidungen trifft – ohne dass dies in der laufenden Überwachung auffällt.

4. Supply-Chain-Angriffe über MCP-Integrationen

Das Model Context Protocol (MCP) und ähnliche Integrationsstandards erweitern die Angriffsfläche erheblich. Kompromittierte Tool-Server oder manipulierte Plugins können als Einfallstor in die gesamte Agent-Infrastruktur dienen.

DORA und AI Agents: Eine regulatorische Lücke wird sichtbar

Die Digital Operational Resilience Act (DORA) der EU ist seit Januar 2025 in Kraft und stellt einen umfassenden Rahmen für die digitale Betriebsresilienz im Finanzsektor auf. Die BaFin hat für 2026 die praktische Umsetzung der DORA-Anforderungen als Schwerpunkt definiert. Doch DORA wurde in einer Welt konzipiert, in der autonome AI Agents noch nicht zum Standardrepertoire der IT-Infrastruktur gehörten.

Die zentralen DORA-Säulen und ihre Relevanz für AI Agents:

| DORA-Anforderung | Herausforderung durch AI Agents | Handlungsbedarf |

|---|---|---|

| ICT-Risikomanagement | Agents handeln autonom und erzeugen neue, schwer vorhersehbare Risikokategorien | Agent-spezifische Risikobewertungen und Kontrollmechanismen |

| Incident Reporting | 33% der Organisationen haben keine audit-fähigen Protokolle für AI-Systeme | Lückenlose Protokollierung aller Agent-Aktionen |

| Resilience Testing | Multi-Turn-Angriffe erfordern neue Testmethoden jenseits klassischer Penetrationstests | Adversarial Testing und Red-Teaming speziell für AI Agents |

| Third-Party Risk Management | MCP-Integrationen und externe LLM-Provider erweitern die Lieferkette | Erweiterte Drittanbieter-Due-Diligence für AI-Toolchains |

| Informationsaustausch | Shadow AI verhindert vollständige Transparenz über Agent-Aktivitäten | Zentrales Agent-Inventar und Discovery-Mechanismen |

BaFin-Fokus 2026: IT-Sicherheit und KI-Aufsicht verschärfen sich

Die BaFin hat unmissverständlich signalisiert, dass IT-Sicherheit und der Einsatz von Künstlicher Intelligenz 2026 im Zentrum der Aufsicht stehen. Allein in den ersten drei Quartalen 2025 meldeten Finanzunternehmen über 500 schwerwiegende IT-Vorfälle an die BaFin. Mit dem Inkrafttreten des deutschen KI-Umsetzungsgesetzes werden KI-Systeme in der Finanzbranche erstmals Teil der regulierten Infrastruktur – mit sofort vollziehbaren Maßnahmen der BaFin im KI-Bereich.

Für Banken und Versicherungen, die bereits AI Agents einsetzen oder deren Einsatz planen, bedeutet das konkret:

- Dokumentationspflichten: Jeder AI Agent, der auf regulatorisch relevante Daten oder Prozesse zugreift, muss vollständig dokumentiert und genehmigt sein.

- Erklärbarkeit: Die Entscheidungsprozesse autonomer Agents müssen nachvollziehbar und auditierbar sein.

- Risikoklassifizierung: AI Agents müssen gemäß ihrem Risikoprofil klassifiziert und entsprechend überwacht werden.

- Ausfallsicherheit: Für jeden kritischen AI Agent muss ein Fallback-Prozess definiert sein.

Ein pragmatischer Fahrplan: AI Agent Governance in fünf Schritten

Basierend auf den aktuellen Erkenntnissen empfehlen wir folgenden Ansatz für Finanzinstitute:

Schritt 1: Agent-Inventarisierung und Shadow-AI-Audit

Verschaffen Sie sich vollständige Transparenz. Identifizieren Sie alle AI Agents in Ihrer Organisation – autorisierte und nicht autorisierte. Angesichts der Tatsache, dass nur 14,4 Prozent der Unternehmen eine vollständige Übersicht haben, ist dies der kritischste erste Schritt.

Schritt 2: Identitäts- und Zugriffsmanagement für Agents

Behandeln Sie AI Agents wie eigenständige Identitäten mit dedizierten Credentials, Berechtigungsprofilen und Audit-Trails. Zero-Trust-Prinzipien müssen konsequent auf Agent-Identitäten angewandt werden.

Schritt 3: Lückenlose Protokollierung und Monitoring

Implementieren Sie End-to-End-Logging für alle Agent-Aktionen. 33 Prozent der Organisationen haben keine audit-fähigen Protokolle – in der regulierten Finanzbranche ist das ein Compliance-Verstoß.

Schritt 4: Adversarial Testing und Red-Teaming

Ergänzen Sie klassische Penetrationstests um spezifische Agent-Tests: Multi-Turn-Prompt-Injection, Tool-Misuse-Szenarien und Memory-Poisoning-Angriffe. Messen Sie die Multi-Turn-Resilienz als eigene Metrik.

Schritt 5: Governance-Framework und DORA-Mapping

Erstellen Sie ein dediziertes AI Agent Governance Framework und mappen Sie es auf die DORA-Anforderungen. Definieren Sie klare Eskalationspfade, menschliche Aufsichtsmechanismen und automatische Abschaltszenarien.

TCO-Betrachtung: Was kostet mangelnde AI-Agent-Sicherheit?

Die Kosten mangelnder Absicherung von AI Agents sind erheblich – und oft unterschätzt:

| Kostenfaktor | Mögliches Szenario | Geschätzte Kosten |

|---|---|---|

| Datenschutzverletzung durch Agent | Agent exfiltriert Kundendaten über kompromittiertes Tool | 500.000 – 5 Mio. € (DSGVO-Bußgeld + Reputationsschaden) |

| DORA-Compliance-Verstoß | Fehlende Protokollierung und Incident-Reporting | Bis zu 2% des Jahresumsatzes |

| Betriebsunterbrechung | Kaskadierende Agent-Fehler in Kernprozessen | 100.000 – 1 Mio. € pro Tag |

| Nachträgliche Absicherung | Retrofit von Security in bestehende Agent-Infrastruktur | 3-5x teurer als Security-by-Design |

Hinweis: Die genannten Kosten stellen mögliche Szenarien dar und basieren auf Branchendurchschnittswerten und regulatorischen Rahmenwerken.

Fazit: Handeln, bevor die Aufsicht handelt

Die Finanzbranche steht an einem Wendepunkt. AI Agents bieten enormes Potenzial für Effizienzsteigerungen, Automatisierung und bessere Kundenservices. Doch die aktuelle Lage zeigt eindeutig: Die Adoption hat die Sicherheit überholt.

Mit der verschärften BaFin-Aufsicht, den DORA-Anforderungen und dem neuen deutschen KI-Umsetzungsgesetz wird das Fenster für proaktives Handeln kleiner. Institute, die jetzt ein robustes AI Agent Governance Framework aufbauen, sichern sich nicht nur regulatorische Compliance – sie schaffen einen echten Wettbewerbsvorteil.

Denn in einer Welt, in der 88 Prozent der Unternehmen bereits Sicherheitsvorfälle durch AI Agents melden, ist die Frage nicht mehr ob, sondern wann das eigene Institut betroffen sein wird.

Sie möchten Ihre AI-Agent-Strategie absichern?

Die Aionda GmbH unterstützt Banken und Versicherungen bei der sicheren Integration von AI Agents – von der Architekturberatung über DORA-Compliance bis hin zur Implementierung robuster Governance-Frameworks. Mit unserem Nearshoring-Ansatz bieten wir hochqualitative Umsetzung zu wirtschaftlich attraktiven Konditionen.

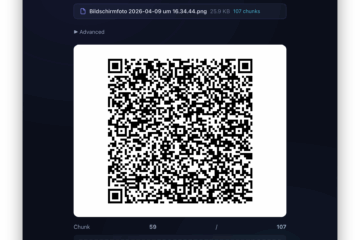

Kontaktieren Sie uns für ein unverbindliches Erstgespräch:

stephan.ferraro@aionda.com

Autor: Stephan Ferraro, Gründer und Geschäftsführer der Aionda GmbH

0 Comments